Изображенията, генерирани от изкуствен интелект, застрашават науката – ето как изследователите искат да ги разпознаят

Изследователите се борят срещу генерираните от AI фалшиви изображения в научни публикации. Разработват се нови методи за откриване.

Изображенията, генерирани от изкуствен интелект, застрашават науката – ето как изследователите искат да ги разпознаят

Учени, манипулиращи числа и масово произвеждащи фалшиви документи Задължителни издатели – проблемните ръкописи отдавна са неудобство в научната литература. Научните детективи работят неуморно, за да разкрие това нарушение и да коригира научните записи. Но работата им става все по-трудна, тъй като се появи нов, мощен инструмент за измамниците: generative изкуствен интелект (AI).

„Генеративният AI се развива много бързо“, казва Яна Кристофър, анализатор на целостта на изображението във FEBS Press в Хайделберг, Германия. „Хората, които работят в моята област – целостта на изображенията и политиките за публикуване – стават все по-загрижени за възможностите, които предоставя.“

Лекотата, с която текстове за генеративни AI инструменти, изображения и данни поражда страхове от все по-ненадеждна научна литература, наводнена с фалшиви числа, ръкописи и заключения, които са трудни за откриване от хората. Вече се заражда надпревара във въоръжаването, тъй като специалисти по почтеност, издатели и технологични компании работят усърдно за Разработване на AI инструменти, което може да помогне за бързото идентифициране на измамни, генерирани от AI елементи в специализирани статии.

„Това е плашещо развитие“, казва Кристофър. „Но има и умни хора и се предлагат добри структурни промени.“

Експертите по почтеност на изследванията съобщават, че въпреки че генерираният от AI текст вече е разрешен при определени обстоятелства от много списания, използването на такива инструменти за създаване на изображения или други данни може да се счита за по-малко приемливо. „В близко бъдеще може да се справим с текста, генериран от AI“, казва Елизабет Бик, специалист по съдебна медицина и консултант в Сан Франциско, Калифорния. „Но аз тегля чертата, когато става дума за генериране на данни.“

Bik, Christopher и други предполагат, че данните, включително изображения, създадени с генеративен AI, вече са широко използвани в литературата и че задължителните издатели използват AI инструменти, за да произвеждат обемни ръкописи (вижте „Тест: Можете ли да разпознаете AI фалшификати?“).

Идентифицирането на изображения, произведени от AI, представлява огромно предизвикателство: те често са почти невъзможни за разграничаване от реални изображения с просто око. „Имаме чувството, че всеки ден се натъкваме на изображения, генерирани от AI“, казва Кристофър. „Но освен ако не можете да го докажете, наистина можете да направите много малко.“

Има някои ясни примери за използването на генеративен AI в научни изображения, като вече скандално известен образ на плъх с абсурдно големи гениталии и безсмислени етикети, създадени с инструмента за изображения Midjourney. Графиката, публикувана от търговско списание през февруари, предизвика буря в социалните медии и беше изтеглено няколко дни по-късно.

Повечето случаи обаче не са толкова очевидни. Фигурите, създадени с помощта на Adobe Photoshop или подобни инструменти преди появата на генеративния AI - особено в молекулярната и клетъчната биология - често съдържат удивителни характеристики, които могат да бъдат разпознати от детективите, като идентичен фон или необичайната липса на ивици или петна. Героите, генерирани от AI, често не показват такива характеристики. „Виждам много документи, които ме карат да си мисля, че тези уестърн петна не изглеждат реални – но няма оръжие“, казва Бик. „Всичко, което можете да кажете, е, че те просто изглеждат странно и, разбира се, това не е достатъчно доказателство, за да се свържете с редактора.“

Въпреки това има признаци, че в публикувани ръкописи се появяват знаци, генерирани от AI. Текстовете, написани с помощта на инструменти като ChatGPT, се увеличават в статиите, очевидно от типичните фрази за чатботове, които авторите забравят да премахнат, и отличителните думи, които AI моделите са склонни да използват. „Така че трябва да приемем, че това се случва и за данни и изображения“, казва Бик.

Друга индикация, че измамниците използват сложни инструменти за изображения е, че повечето от проблемите, които изследователите откриват в момента, се появяват в произведения, които са на няколко години. „През последните години виждаме все по-малко проблеми с изображенията“, казва Бик. „Мисля, че повечето хора, които бяха хванати да манипулират изображения, започнаха да създават по-чисти изображения.“

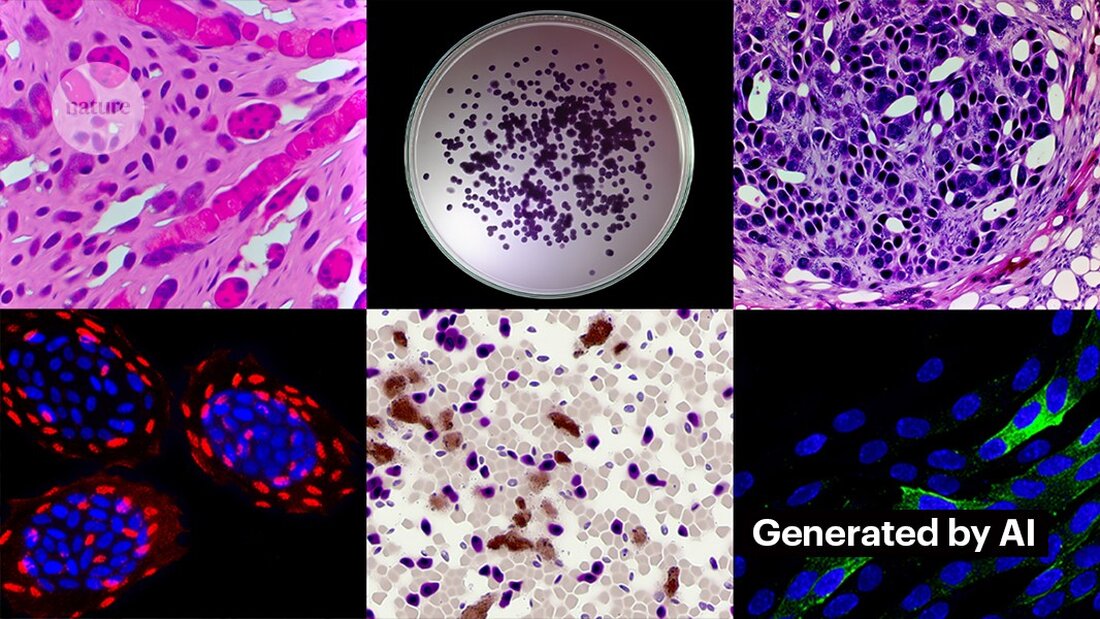

Създаването на чисти изображения с генериращ AI не е трудно. Кевин Патрик, детектив по научни изображения, известен като Чешър в социалните медии, демонстрира колко лесно може да бъде и публикува откритията си в X. Използвайки инструмента за изкуствен интелект на Photoshop Generative Fill, Патрик създаде реалистични изображения - които биха могли да се появят в научни статии - на тумори, клетъчни култури, Western blots и др. Създаването на повечето изображения отне по-малко от минута (вижте „Генериране на фалшива наука“).

„Ако мога да направя това, тогава със сигурност тези, на които им се плаща да създават фалшиви данни, също ще го направят“, казва Патрик. „Вероятно има много други данни, които могат да бъдат генерирани с помощта на инструменти като този.“

Някои издатели съобщават, че са открили доказателства за генерирано от AI съдържание в публикувани проучвания. Това включва PLoS, която е била предупредена за подозрително съдържание и е открила доказателства за генериран от AI текст и данни в статии и изявления чрез вътрешни разследвания, казва Рене Хох, редактор на екипа по етика на публикациите на PLoS в Сан Франциско, Калифорния. (Хох отбелязва, че използването на AI не е забранено в списанията на PLoS и че политиката за AI се основава на отговорност на автора и прозрачни разкривания.)

Други инструменти също могат да предоставят възможности за хора, които искат да създават фалшиво съдържание. Миналия месец изследователи публикуваха a 1 генериращ AI модел за създаване на микроскопски изображения с висока разделителна способност – и някои специалисти по почтеност изразиха загриженост относно тази работа. „Тази технология може лесно да се използва от хора с лоши намерения за бързо създаване на стотици или хиляди фалшиви изображения“, казва Бик.

Йоав Шехтман от Технион-Израелския технологичен институт в Хайфа, създателят на инструмента, казва, че инструментът е полезен за създаване на обучителни данни за модели, тъй като микроскопските изображения с висока разделителна способност са трудни за получаване. Но той добавя, че не е полезно за генериране на фалшификати, тъй като потребителите имат малък контрол върху резултатите. Съществуващият софтуер за редактиране на изображения като Photoshop е по-полезен за манипулиране на фигури, предполага той.

Въпреки че човешките очи може да не могат Разпознавайте изображения, генерирани от AI, изкуственият интелект би могъл да направи това (вижте „Изображенията с изкуствен интелект са трудни за разпознаване“).

Разработчиците на инструменти като Imagetwin и Proofig, които използват AI за откриване на проблеми с целостта на научни изображения, разширяват софтуера си, за да филтрират изображения, създадени от генеративен AI. Тъй като такива изображения са толкова трудни за разпознаване, двете компании създават свои собствени бази данни от генеративни AI изображения, за да обучат своите алгоритми.

Proofig вече пусна функция в своя инструмент за разпознаване на микроскопски изображения, генерирани от AI. Съоснователят Дрор Колодкин-Гал в Реховот, Израел, казва, че при тестване с хиляди генерирани от AI и реални изображения от статии, алгоритъмът правилно идентифицира AI изображения в 98% от времето и има фалшиво положителен процент от 0,02%. Dror добавя, че екипът сега се опитва да разбере какво точно открива техният алгоритъм.

„Имам големи надежди за тези инструменти“, казва Кристофър. Тя обаче отбелязва, че техните резултати винаги трябва да бъдат оценявани от експерти, които могат да проверят проблемите, които посочват. Кристофър все още не е видял никакви доказателства, че софтуерът за разпознаване на изображения с изкуствен интелект е надежден (вътрешната оценка на Proofig все още не е публикувана). Тези инструменти са „ограничени, но със сигурност много полезни, като ни позволяват да мащабираме усилията си за преглед на подаването“, добавя тя.

Много издатели и изследователски институции вече го използват Доказателство и Imagetwin. Например научните списания използват Proofig за проверка на проблеми с целостта на изображенията. Според Мейгън Фелан, директор по комуникациите на Science във Вашингтон, инструментът все още не е открил изображения, генерирани от AI.

Springer Nature, издателят на Nature, разработва свои собствени инструменти за откриване на текст и изображения, наречени Geppetto и SnapShot, които маркират нередности, които след това се оценяват от хората. (Екипът за новини на Nature е редакционно независим от своя издател.)

Издателските групи също предприемат стъпки, за да отговорят на изображения, генерирани от AI. Говорител на Международната асоциация на издателите на научни, технически и медицински (STM) в Оксфорд, Обединеното кралство, каза, че приема въпроса „много сериозно“ и отговаря на инициативи като United2Act и STM Integrity Hub, който се занимава с текущи проблеми със задължително публикуване и други въпроси, свързани с академичната почтеност.

Кристофър, който ръководи STM работна група за промени и дублиране на изображения, казва, че има нарастващо осъзнаване, че ще е необходимо да се разработят начини за проверка на необработените данни - например чрез етикетиране на изображения, направени с микроскопи, с невидими водни знаци, подобни на използваните Водни знаци в текстове, генерирани от AI – това може да е правилният начин. Това изисква нови технологии и нови стандарти за производителите на устройства, добавя тя.

Патрик и други се тревожат, че издателите не действат достатъчно бързо, за да се справят със заплахата. „Страхуваме се, че това ще бъде просто още едно поколение проблеми в литературата, на които те не се обръщат, докато не стане твърде късно“, казва той.

Все пак някои са оптимисти, че генерираното от AI съдържание, което се появява в статиите днес, ще бъде открито в бъдеще.

„Имам пълна увереност, че технологията ще се подобри до точката, в която разпознава данните, които се създават днес – защото в един момент това ще се счита за относително грубо“, казва Патрик. "Измамниците не трябва да спят спокойно през нощта. Те биха могли да заблудят текущия процес, но не мисля, че могат да заблудят процеса завинаги."

-

Saguy, A. et al. Малък мет. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto