Οι εικόνες που δημιουργούνται από την τεχνητή νοημοσύνη θέτουν σε κίνδυνο την επιστήμη – έτσι θέλουν οι ερευνητές να τις αναγνωρίσουν

Οι ερευνητές μάχονται ενάντια στις ψεύτικες εικόνες που δημιουργούνται από AI σε επιστημονικές δημοσιεύσεις. Νέες μέθοδοι ανίχνευσης αναπτύσσονται.

Οι εικόνες που δημιουργούνται από την τεχνητή νοημοσύνη θέτουν σε κίνδυνο την επιστήμη – έτσι θέλουν οι ερευνητές να τις αναγνωρίσουν

Επιστήμονες χειραγωγούν αριθμούς και παράγουν μαζικά πλαστά χαρτιά Υποχρεωτικοί εκδότες – τα προβληματικά χειρόγραφα είναι εδώ και καιρό ενοχλητικό στην επιστημονική βιβλιογραφία. Οι επιστημονικοί ντετέκτιβ εργάζονται ακούραστα, για να αποκαλύψει αυτό το λάθος και να διορθώσει το επιστημονικό αρχείο. Αλλά η δουλειά τους γίνεται ολοένα και πιο δύσκολη καθώς έχει εμφανιστεί ένα νέο, ισχυρό εργαλείο για απατεώνες: γεννητικό τεχνητή νοημοσύνη (ΟΛΑ ΣΥΜΠΕΡΙΛΑΜΒΑΝΟΝΤΑΙ).

«Το Generative AI αναπτύσσεται πολύ γρήγορα», λέει Τζάνα Κρίστοφερ, Image Integrity Analyst στο FEBS Press στη Χαϊδελβέργη, Γερμανία. «Οι άνθρωποι που εργάζονται στην περιοχή μου – ακεραιότητα εικόνας και πολιτικές δημοσίευσης – ανησυχούν όλο και περισσότερο για τις δυνατότητες που παρουσιάζει».

Η ευκολία με την οποία κείμενα εργαλείων τεχνητής νοημοσύνης, εικόνες και δεδομένα εγείρουν φόβους για μια ολοένα και πιο αναξιόπιστη επιστημονική βιβλιογραφία, πλημμυρισμένη από ψεύτικους αριθμούς, χειρόγραφα και συμπεράσματα που είναι δύσκολο να ανιχνευθούν από τον άνθρωπο. Μια κούρσα εξοπλισμών αναδύεται ήδη καθώς ειδικοί ακεραιότητας, εκδότες και εταιρείες τεχνολογίας εργάζονται επιμελώς για να Αναπτύξτε εργαλεία AI, που μπορεί να βοηθήσει στον γρήγορο εντοπισμό παραπλανητικών στοιχείων που δημιουργούνται από AI σε εξειδικευμένα άρθρα.

«Είναι μια τρομακτική εξέλιξη», λέει ο Κρίστοφερ. «Αλλά υπάρχουν επίσης έξυπνοι άνθρωποι και καλές διαρθρωτικές αλλαγές που προτείνονται».

Οι ειδικοί στην ακεραιότητα της έρευνας αναφέρουν ότι αν και το κείμενο που δημιουργείται από AI επιτρέπεται ήδη υπό ορισμένες συνθήκες από πολλά περιοδικά, η χρήση τέτοιων εργαλείων για τη δημιουργία εικόνων ή άλλων δεδομένων μπορεί να θεωρείται λιγότερο αποδεκτή. «Στο εγγύς μέλλον, μπορεί να είμαστε εντάξει με το κείμενο που δημιουργείται από AI», λέει Ελίζαμπεθ Μπικ, ειδικός και σύμβουλος εγκληματολογίας εικόνας στο Σαν Φρανσίσκο της Καλιφόρνια. «Αλλά χαράζω τη γραμμή όταν πρόκειται για τη δημιουργία δεδομένων».

Ο Bik, ο Christopher και άλλοι προτείνουν ότι τα δεδομένα, συμπεριλαμβανομένων των εικόνων, που δημιουργήθηκαν με γενετική τεχνητή νοημοσύνη χρησιμοποιούνται ήδη ευρέως στη λογοτεχνία και ότι οι υποχρεωτικοί εκδότες χρησιμοποιούν εργαλεία τεχνητής νοημοσύνης για να παράγουν χειρόγραφα σε όγκο (βλ. «Quiz: Can You Spot AI Forgeries;»).

Ο εντοπισμός εικόνων που παράγονται από AI αποτελεί μια τεράστια πρόκληση: είναι συχνά σχεδόν αδύνατο να διακριθούν από τις πραγματικές εικόνες με γυμνό μάτι. «Αισθανόμαστε σαν να συναντάμε εικόνες που δημιουργούνται από AI κάθε μέρα», λέει ο Christopher. «Αλλά αν δεν μπορείτε να το αποδείξετε, υπάρχουν πραγματικά πολύ λίγα που μπορείτε να κάνετε».

Υπάρχουν ορισμένα ξεκάθαρα παραδείγματα χρήσης της γενετικής τεχνητής νοημοσύνης σε επιστημονικές εικόνες, όπως η τώρα διαβόητη εικόνα ενός αρουραίου με παράλογα μεγάλα γεννητικά όργανα και ανόητες ετικέτες, που δημιουργήθηκαν με το εργαλείο εικόνας Midjourney. Το γραφικό, που δημοσιεύτηκε από εμπορικό περιοδικό τον Φεβρουάριο, προκάλεσε θύελλα στα social media και ήταν αποσύρθηκε λίγες μέρες αργότερα.

Ωστόσο, οι περισσότερες περιπτώσεις δεν είναι τόσο προφανείς. Οι φιγούρες που δημιουργήθηκαν χρησιμοποιώντας το Adobe Photoshop ή παρόμοια εργαλεία πριν από την εμφάνιση της γενετικής τεχνητής νοημοσύνης - ιδιαίτερα στη μοριακή και κυτταρική βιολογία - περιέχουν συχνά εντυπωσιακά χαρακτηριστικά που μπορούν να αναγνωριστούν από τους ντετέκτιβ, όπως πανομοιότυπα υπόβαθρα ή ασυνήθιστη έλλειψη ραβδώσεων ή κηλίδων. Οι χαρακτήρες που δημιουργούνται από AI συχνά δεν εμφανίζουν τέτοια χαρακτηριστικά. «Βλέπω πολλά χαρτιά που με κάνουν να πιστεύω ότι αυτές οι κηλίδες Western δεν φαίνονται αληθινές - αλλά δεν υπάρχει όπλο καπνίσματος», λέει ο Bik. «Το μόνο που μπορείτε να πείτε είναι ότι φαίνονται παράξενα και φυσικά αυτό δεν είναι αρκετό για να επικοινωνήσετε με τον εκδότη».

Ωστόσο, υπάρχουν ενδείξεις ότι χαρακτήρες που δημιουργούνται από AI εμφανίζονται σε δημοσιευμένα χειρόγραφα. Τα κείμενα που γράφονται με εργαλεία όπως το ChatGPT αυξάνονται σε άρθρα, όπως φαίνεται από τυπικές φράσεις chatbot που οι συγγραφείς ξεχνούν να αφαιρέσουν και διακριτικές λέξεις που τείνουν να χρησιμοποιούν τα μοντέλα τεχνητής νοημοσύνης. «Έτσι πρέπει να υποθέσουμε ότι αυτό συμβαίνει και για δεδομένα και εικόνες», λέει ο Bik.

Μια άλλη ένδειξη ότι οι απατεώνες χρησιμοποιούν εξελιγμένα εργαλεία απεικόνισης είναι ότι τα περισσότερα από τα προβλήματα που εντοπίζουν επί του παρόντος οι ερευνητές εμφανίζονται σε έργα πολλών ετών. «Τα τελευταία χρόνια έχουμε δει όλο και λιγότερα προβλήματα με τις εικόνες», λέει ο Bik. «Νομίζω ότι οι περισσότεροι άνθρωποι που πιάστηκαν να χειραγωγούν εικόνες άρχισαν να δημιουργούν πιο καθαρές εικόνες».

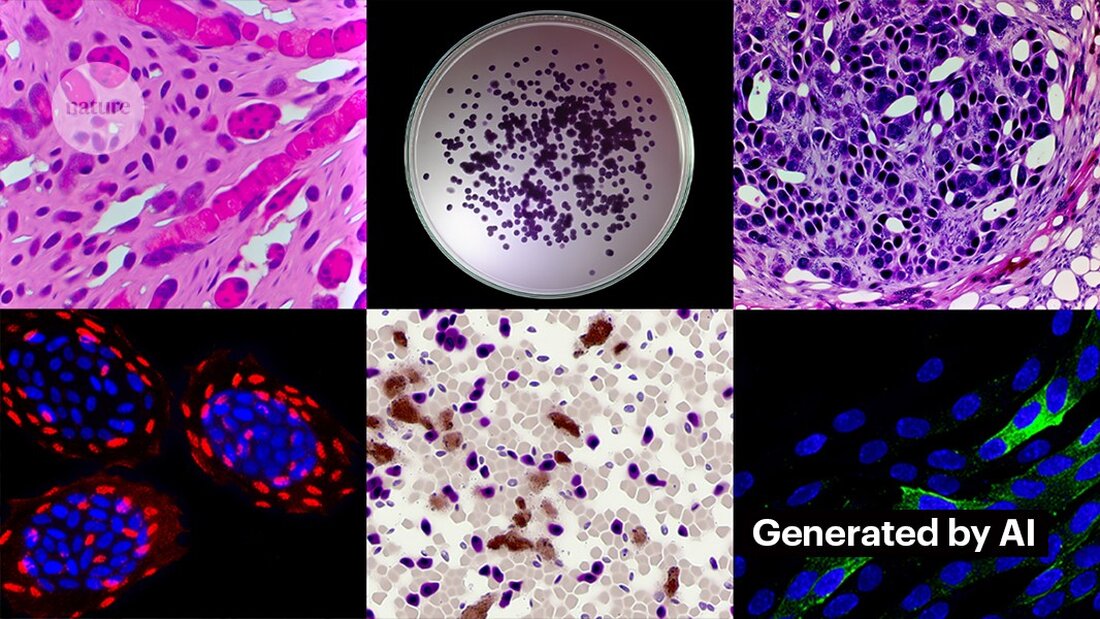

Η δημιουργία καθαρών εικόνων με γενετική τεχνητή νοημοσύνη δεν είναι δύσκολη. Ο Kevin Patrick, ένας επιστημονικός ντετέκτιβ εικόνων γνωστός ως Cheshire στα μέσα κοινωνικής δικτύωσης, έδειξε πόσο εύκολο μπορεί να είναι και δημοσίευσε τα ευρήματά του στο X. Χρησιμοποιώντας το εργαλείο AI του Photoshop Generative Fill, ο Patrick δημιούργησε ρεαλιστικές εικόνες - που θα μπορούσαν να εμφανιστούν σε επιστημονικές εργασίες - όγκων, κυτταροκαλλιεργειών, Western blots και άλλα. Οι περισσότερες εικόνες χρειάστηκαν λιγότερο από ένα λεπτό για να δημιουργηθούν (δείτε «Δημιουργία ψευδούς επιστήμης»).

«Αν μπορώ να το κάνω αυτό, τότε σίγουρα θα το κάνουν και αυτοί που πληρώνονται για να δημιουργούν πλαστά δεδομένα», λέει ο Πάτρικ. "Υπάρχουν πιθανώς πολλά άλλα δεδομένα που θα μπορούσαν να δημιουργηθούν χρησιμοποιώντας εργαλεία όπως αυτό."

Ορισμένοι εκδότες αναφέρουν ότι βρήκαν στοιχεία περιεχομένου που δημιουργείται από AI σε δημοσιευμένες μελέτες. Αυτό περιλαμβάνει το PLoS, το οποίο έχει ειδοποιηθεί για ύποπτο περιεχόμενο και βρήκε στοιχεία για κείμενο και δεδομένα που δημιουργήθηκαν από AI σε άρθρα και υποβολές μέσω εσωτερικών ερευνών, λέει ο Renée Hoch, συντάκτης της ομάδας δεοντολογίας της δημοσίευσης του PLoS στο Σαν Φρανσίσκο της Καλιφόρνια. (Η Hoch σημειώνει ότι η χρήση AI δεν απαγορεύεται στα περιοδικά PLoS και ότι η πολιτική AI βασίζεται στην ευθύνη του συγγραφέα και στις διαφανείς αποκαλύψεις.)

Άλλα εργαλεία θα μπορούσαν επίσης να παρέχουν ευκαιρίες σε άτομα που θέλουν να δημιουργήσουν ψεύτικο περιεχόμενο. Τον περασμένο μήνα οι ερευνητές δημοσίευσαν ένα 1 Δημιουργικό μοντέλο τεχνητής νοημοσύνης για τη δημιουργία εικόνων μικροσκοπίου υψηλής ανάλυσης – και ορισμένοι ειδικοί στην ακεραιότητα εξέφρασαν ανησυχίες για αυτήν την εργασία. «Αυτή η τεχνολογία μπορεί εύκολα να χρησιμοποιηθεί από άτομα με κακές προθέσεις για να δημιουργήσουν γρήγορα εκατοντάδες ή χιλιάδες ψεύτικες εικόνες», λέει ο Bik.

Ο Yoav Shechtman του Ινστιτούτου Τεχνολογίας Technion-Israel στη Χάιφα, ο δημιουργός του εργαλείου, λέει ότι το εργαλείο είναι χρήσιμο για τη δημιουργία δεδομένων εκπαίδευσης για μοντέλα, επειδή είναι δύσκολο να ληφθούν εικόνες μικροσκοπίου υψηλής ανάλυσης. Αλλά προσθέτει ότι δεν είναι χρήσιμο για τη δημιουργία πλαστών επειδή οι χρήστες έχουν ελάχιστο έλεγχο στα αποτελέσματα. Το υπάρχον λογισμικό επεξεργασίας εικόνων, όπως το Photoshop, είναι πιο χρήσιμο για τον χειρισμό ψηφίων, προτείνει.

Αν και τα ανθρώπινα μάτια μπορεί να μην μπορούν Αναγνωρίστε τις εικόνες που δημιουργούνται από AI, η τεχνητή νοημοσύνη θα μπορούσε ενδεχομένως να το κάνει αυτό (δείτε «Οι εικόνες AI είναι δύσκολο να αναγνωριστούν»).

Οι προγραμματιστές εργαλείων όπως το Imagetwin και το Proofig, που χρησιμοποιούν τεχνητή νοημοσύνη για τον εντοπισμό προβλημάτων ακεραιότητας σε επιστημονικές εικόνες, επεκτείνουν το λογισμικό τους για να φιλτράρουν εικόνες που δημιουργούνται από γενετική τεχνητή νοημοσύνη. Επειδή τέτοιες εικόνες είναι τόσο δύσκολο να αναγνωριστούν, και οι δύο εταιρείες δημιουργούν τις δικές τους βάσεις δεδομένων με εικόνες παραγωγής τεχνητής νοημοσύνης για να εκπαιδεύσουν τους αλγόριθμους τους.

Η Proofig έχει ήδη κυκλοφορήσει μια δυνατότητα στο εργαλείο της για την αναγνώριση εικόνων μικροσκοπίου που δημιουργούνται από AI. Ο συνιδρυτής Dror Kolodkin-Gal στο Rehovot του Ισραήλ, λέει ότι σε δοκιμές με χιλιάδες δημιουργημένες από τεχνητή νοημοσύνη και πραγματικές εικόνες από άρθρα, ο αλγόριθμος εντόπισε σωστά τις εικόνες τεχνητής νοημοσύνης το 98% των περιπτώσεων και είχε ένα ψευδώς θετικό ποσοστό 0,02%. Ο Dror προσθέτει ότι η ομάδα προσπαθεί τώρα να καταλάβει τι ακριβώς εντοπίζει ο αλγόριθμός τους.

«Έχω μεγάλες ελπίδες για αυτά τα εργαλεία», λέει ο Christopher. Ωστόσο, σημειώνει ότι τα αποτελέσματά τους πρέπει πάντα να αξιολογούνται από ειδικούς που μπορούν να επαληθεύσουν τα προβλήματα που υποδεικνύουν. Ο Christopher δεν έχει δει ακόμη κανένα στοιχείο ότι το λογισμικό αναγνώρισης εικόνων AI είναι αξιόπιστο (η εσωτερική αξιολόγηση της Proofig δεν έχει ακόμη δημοσιευτεί). Αυτά τα εργαλεία είναι «περιορισμένα, αλλά σίγουρα πολύ χρήσιμα για να μας επιτρέψουν να κλιμακώσουμε τις προσπάθειές μας για έλεγχο υποβολής», προσθέτει.

Πολλοί εκδότες και ερευνητικά ιδρύματα το χρησιμοποιούν ήδη Απόδειξη και Imagetwin. Για παράδειγμα, τα περιοδικά Science χρησιμοποιούν το Proofig για να ελέγξουν ζητήματα ακεραιότητας σε εικόνες. Σύμφωνα με τον Meagan Phelan, διευθυντή επικοινωνίας για το Science στην Ουάσιγκτον, το εργαλείο δεν έχει ανακαλύψει ακόμη εικόνες που έχουν δημιουργηθεί από AI.

Ο Springer Nature, ο εκδότης του Nature, αναπτύσσει τα δικά του εργαλεία ανίχνευσης κειμένου και εικόνων, που ονομάζονται Geppetto και SnapShot, τα οποία επισημαίνουν παρατυπίες που στη συνέχεια αξιολογούνται από ανθρώπους. (Η ομάδα ειδήσεων Nature είναι συντακτική ανεξάρτητη από τον εκδότη της.)

Οι ομάδες δημοσίευσης λαμβάνουν επίσης μέτρα για να ανταποκριθούν στις εικόνες που δημιουργούνται από AI. Ένας εκπρόσωπος της Διεθνούς Ένωσης Επιστημονικών, Τεχνικών και Ιατρικών Εκδοτών (STM) στην Οξφόρδη του Ηνωμένου Βασιλείου, δήλωσε ότι αντιμετωπίζει το θέμα «πολύ σοβαρά» και ανταποκρίνεται σε πρωτοβουλίες όπως United2Act και το STM Integrity Hub, το οποίο αντιμετωπίζει τρέχοντα ζητήματα με υποχρεωτική δημοσίευση και άλλα θέματα ακαδημαϊκής ακεραιότητας.

Ο Christopher, ο οποίος ηγείται μιας ομάδας εργασίας STM για τις αλλοιώσεις και τις αντιγραφές εικόνων, λέει ότι υπάρχει μια αυξανόμενη επίγνωση ότι θα είναι απαραίτητο να αναπτυχθούν τρόποι για την επαλήθευση των πρωτογενών δεδομένων - για παράδειγμα, με την επισήμανση εικόνων που λαμβάνονται με μικροσκόπια με αόρατα υδατογραφήματα παρόμοια με αυτά που χρησιμοποιούνται Υδατογράφημα σε κείμενα που δημιουργούνται από AI – αυτός θα μπορούσε να είναι ο σωστός τρόπος. Αυτό απαιτεί νέες τεχνολογίες και νέα πρότυπα για τους κατασκευαστές συσκευών, προσθέτει.

Ο Πάτρικ και άλλοι ανησυχούν ότι οι εκδότες δεν ενεργούν αρκετά γρήγορα για να αντιμετωπίσουν την απειλή. «Φοβόμαστε ότι αυτό θα είναι απλώς μια άλλη γενιά προβλημάτων στη βιβλιογραφία που δεν αντιμετωπίζουν μέχρι να είναι πολύ αργά», λέει.

Ωστόσο, ορισμένοι είναι αισιόδοξοι ότι το περιεχόμενο που δημιουργείται από AI που εμφανίζεται σε άρθρα σήμερα θα ανακαλυφθεί στο μέλλον.

«Έχω απόλυτη πεποίθηση ότι η τεχνολογία θα βελτιωθεί σε σημείο που να αναγνωρίζει τα δεδομένα που δημιουργούνται σήμερα – γιατί κάποια στιγμή αυτό θα θεωρηθεί σχετικά χονδροειδές», λέει ο Πάτρικ. "Οι απατεώνες δεν πρέπει να κοιμούνται καλά τη νύχτα. Θα μπορούσαν να ξεγελάσουν την τρέχουσα διαδικασία, αλλά δεν νομίζω ότι μπορούν να ξεγελάσουν τη διαδικασία για πάντα."

-

Saguy, Α. et al. Small Meth. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto