Tekoälyn luomat kuvat vaarantavat tieteen – näin tutkijat haluavat tunnistaa ne

Tutkijat taistelevat tekoälyn luomia väärennettyjä kuvia vastaan tieteellisissä julkaisuissa. Uusia havaitsemismenetelmiä kehitetään.

Tekoälyn luomat kuvat vaarantavat tieteen – näin tutkijat haluavat tunnistaa ne

Tutkijat manipuloivat numeroita ja tuottavat massatuottamaan väärennettyjä papereita Pakolliset julkaisijat – Ongelmalliset käsikirjoitukset ovat pitkään olleet haitaksi tieteellisessä kirjallisuudessa. Tieteelliset etsivät työskentelevät väsymättä, paljastaakseen tämän väärinkäytön ja korjatakseen tieteelliset tiedot. Mutta heidän työnsä on yhä vaikeampaa, kun uusi, tehokas työkalu huijareille on ilmaantunut: generatiivinen tekoälyä (AI).

"Generatiivinen tekoäly kehittyy erittäin nopeasti", sanoo Jana Christopher, Image Integrity Analyst at FEBS Press, Heidelberg, Saksa. "Alallani työskentelevät ihmiset - kuvan eheys ja julkaisukäytännöt - ovat yhä enemmän huolissaan sen tarjoamista mahdollisuuksista."

Helppous, jolla generatiivisten AI-työkalujen tekstejä, kuvat ja data herättävät pelkoa yhä epäluotettavasta tieteellisestä kirjallisuudesta, joka on täynnä väärennettyjä numeroita, käsikirjoituksia ja johtopäätöksiä, joita ihmisten on vaikea havaita. Kilpavarustelu on jo syntymässä, kun rehellisyyden asiantuntijat, kustantajat ja teknologiayritykset työskentelevät ahkerasti Kehitä tekoälytyökaluja, joka voi auttaa tunnistamaan nopeasti harhaanjohtavia tekoälyn luomia elementtejä erikoisartikkeleista.

"Se on pelottavaa", Christopher sanoo. "Mutta myös älykkäitä ihmisiä ja hyviä rakennemuutoksia ehdotetaan."

Tutkimuksen eheyden asiantuntijat raportoivat, että vaikka tekoälyn luoman tekstin käyttö sallitaan jo tietyissä olosuhteissa useissa aikakauslehdissä, tällaisten työkalujen käyttöä kuvien tai muun datan luomiseen voidaan pitää vähemmän hyväksyttävänä. "Lähitulevaisuudessa voimme ehkä hyväksyä tekoälyn luoman tekstin", sanoo Elisabeth Bik, kuvarikosteknisen asiantuntijan ja konsultin San Franciscossa, Kaliforniassa. "Mutta vedän rajan tiedon tuottamiseen."

Bik, Christopher ja muut ehdottavat, että generatiivisella tekoälyllä luotua dataa, mukaan lukien kuvat, käytetään jo laajasti kirjallisuudessa ja että pakolliset julkaisijat käyttävät tekoälytyökaluja tuottamaan käsikirjoituksia volyyminä (katso Tietovisa: Voitko havaita tekoälyväärennöksiä?).

Tekoälyllä tuotettujen kuvien tunnistaminen on valtava haaste: niitä on usein lähes mahdotonta erottaa todellisista kuvista paljaalla silmällä. "Meistä tuntuu, että törmäämme tekoälyn luomiin kuviin joka päivä", Christopher sanoo. "Mutta ellet pysty todistamaan sitä, voit tehdä todella vähän."

On olemassa joitain selkeitä esimerkkejä generatiivisen tekoälyn käytöstä tieteellisissä kuvissa, kuten nyt surullisen kuuluisa kuva rottasta, jolla on järjettömän suuret sukuelimet ja järjettömiä tarroja, jotka on luotu Midjourney-kuvatyökalulla. Ammattilehden helmikuussa julkaisema grafiikka aiheutti myrskyn sosiaalisessa mediassa ja oli poistettiin muutaman päivän kuluttua.

Useimmat tapaukset eivät kuitenkaan ole niin ilmeisiä. Figuurit, jotka on luotu Adobe Photoshopilla tai vastaavilla työkaluilla ennen generatiivisen tekoälyn tuloa - erityisesti molekyyli- ja solubiologiassa - sisältävät usein silmiinpistäviä piirteitä, jotka etsivät voivat tunnistaa, kuten identtiset taustat tai epätavallinen juovien tai pisteiden puuttuminen. Tekoälyn luomilla hahmoilla ei useinkaan ole tällaisia ominaisuuksia. "Näen monia papereita, jotka saavat minut ajattelemaan, että nämä Western blotit eivät näytä todellisilta - mutta siellä ei ole savupissiä", Bik sanoo. "Voit vain sanoa, että ne vain näyttävät oudolta, ja se ei tietenkään riitä todisteeksi ottamaan yhteyttä toimittajaan."

On kuitenkin merkkejä siitä, että tekoälyn luomia hahmoja esiintyy julkaistuissa käsikirjoituksissa. ChatGPT:n kaltaisilla työkaluilla kirjoitetut tekstit lisääntyvät artikkeleissa, mikä ilmenee tyypillisistä chatbot-lauseista, jotka kirjoittajat unohtavat poistaa, ja erottuvista sanoista, joita tekoälymallit yleensä käyttävät. "Joten meidän on oletettava, että tämä tapahtuu myös datalle ja kuville", Bik sanoo.

Toinen osoitus siitä, että huijarit käyttävät kehittyneitä kuvantamistyökaluja, on se, että suurin osa tutkijoiden tällä hetkellä löytämistä ongelmista esiintyy useita vuosia vanhoissa teoksissa. "Viime vuosina olemme nähneet yhä vähemmän ongelmia kuvien kanssa", sanoo Bik. "Uskon, että useimmat ihmiset, jotka jäivät kiinni kuvien manipuloinnista, alkoivat luoda puhtaampia kuvia."

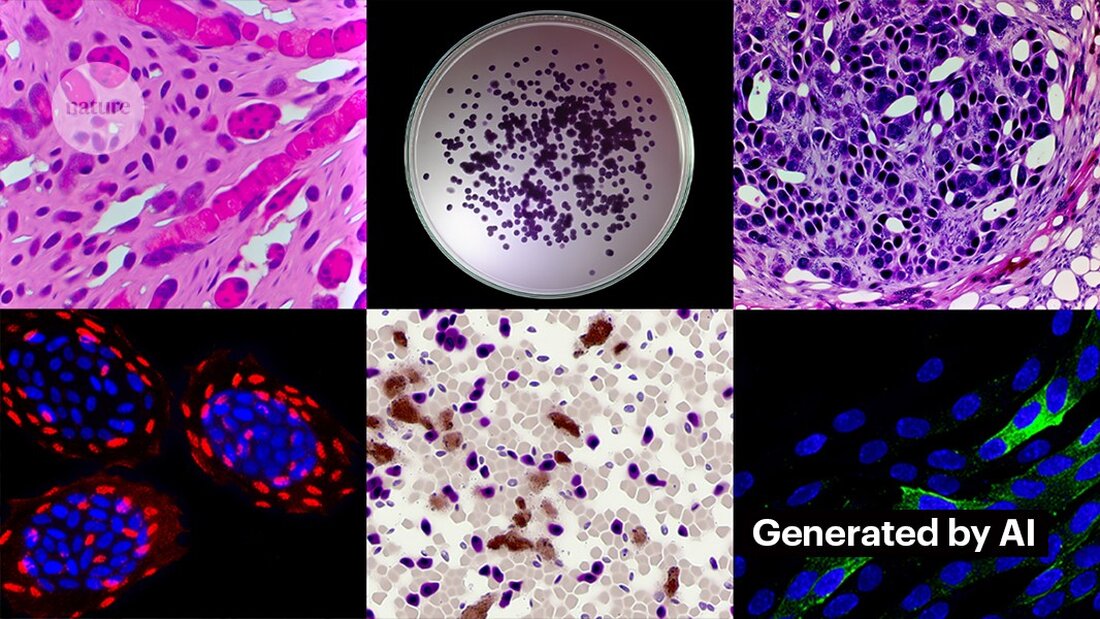

Puhtaiden kuvien luominen generatiivisella tekoälyllä ei ole vaikeaa. Kevin Patrick, tieteellinen kuvaetsivä, joka tunnetaan nimellä Cheshire sosiaalisessa mediassa, on osoittanut, kuinka helppoa se voi olla, ja julkaissut havaintonsa X:ssä. Käyttämällä Photoshopin tekoälytyökalua Generative Fill Patrick loi realistisia kuvia – joita voisi esiintyä tieteellisissä kirjoituksissa – kasvaimista, soluviljelmistä, Western blot -testeistä ja muista. Useimpien kuvien luominen kesti alle minuutin (katso "Väären tieteen luominen").

"Jos minä pystyn siihen, niin varmasti myös ne, joille maksetaan väärennetyn datan luomisesta, tekevät sen", Patrick sanoo. "On luultavasti paljon muuta dataa, jota voitaisiin luoda tällaisilla työkaluilla."

Jotkut julkaisijat raportoivat löytäneensä todisteita tekoälyn luomasta sisällöstä julkaistuissa tutkimuksissa. Tämä sisältää PLoS:n, joka on saanut hälytyksen epäilyttävästä sisällöstä ja joka on löytänyt todisteita tekoälyn luomasta tekstistä ja tiedoista artikkeleista ja lähetyksistä sisäisten tutkimusten kautta, sanoo Renée Hoch, PLoS:n julkaisuetiikkatiimin toimittaja San Franciscossa, Kaliforniassa. (Hoch huomauttaa, että tekoälyn käyttö ei ole kiellettyä PLoS-lehdissä ja että tekoälypolitiikka perustuu tekijän vastuuseen ja läpinäkyviin ilmoituksiin.)

Myös muut työkalut voivat tarjota mahdollisuuksia ihmisille, jotka haluavat luoda väärennettyä sisältöä. Viime kuussa tutkijat julkaisivat a 1 generoiva tekoälymalli korkearesoluutioisten mikroskooppikuvien luomiseen – ja jotkut eheysasiantuntijat ilmaisivat huolensa tästä työstä. "Tätä tekniikkaa voivat helposti käyttää ihmiset, joilla on huonoja aikomuksia luodakseen nopeasti satoja tai tuhansia väärennettyjä kuvia", Bik sanoo.

Yoav Shechtman Technion–Israel Institute of Technologysta Haifassa, työkalun luoja, sanoo työkalun olevan hyödyllinen mallien harjoitustietojen luomiseen, koska korkearesoluutioisia mikroskooppikuvia on vaikea saada. Mutta hän lisää, että se ei ole hyödyllinen väärennösten luomiseen, koska käyttäjät eivät voi hallita tuloksia. Olemassa olevat kuvankäsittelyohjelmat, kuten Photoshop, ovat hyödyllisempiä lukujen käsittelyssä, hän ehdottaa.

Vaikka ihmissilmät eivät ehkä pysty siihen Tunnista tekoälyn luomat kuvat, tekoäly voisi mahdollisesti tehdä tämän (katso "AI-kuvia on vaikea tunnistaa").

Sellaisten työkalujen, kuten Imagetwin ja Proofig, kehittäjät, jotka käyttävät tekoälyä havaitakseen tieteellisten kuvien eheysongelmia, laajentavat ohjelmistojaan suodattamaan generatiivisen tekoälyn luomia kuvia. Koska tällaisia kuvia on niin vaikea tunnistaa, molemmat yritykset luovat omia tietokantojaan generatiivisista tekoälykuvista harjoittaakseen algoritmejaan.

Proofig on jo julkaissut työkalussaan ominaisuuden tekoälyn luomien mikroskooppikuvien tunnistamiseen. Toinen perustajista Dror Kolodkin-Gal Rehovotissa, Israelissa, sanoo, että testattaessa tuhansia tekoälyn luomia ja todellisia kuvia artikkeleista, algoritmi tunnisti tekoälykuvat oikein 98 % ajasta ja virheellisten positiivisten prosenttiosuus oli 0,02 %. Dror lisää, että tiimi yrittää nyt ymmärtää, mitä heidän algoritminsa tarkalleen havaitsee.

"Minulla on suuria toiveita näiden työkalujen suhteen", Christopher sanoo. Hän kuitenkin huomauttaa, että niiden tulokset on aina arvioitava asiantuntijoiden toimesta, jotka voivat tarkistaa heidän ilmoittamansa ongelmat. Christopher ei ole vielä nähnyt todisteita tekoälykuvantunnistusohjelmiston luotettavuudesta (Proofigin sisäistä arviointia ei ole vielä julkaistu). Nämä työkalut ovat "rajoitettuja, mutta varmasti erittäin hyödyllisiä, jotta voimme skaalata lähetysten tarkistusponnistelujamme", hän lisää.

Monet kustantajat ja tutkimuslaitokset käyttävät sitä jo nyt Todistus ja Imagetwin. Esimerkiksi Science-lehdet käyttävät Proofig-ohjelmaa kuvien eheysongelmien tarkistamiseen. Washington DC:n Sciencen viestintäjohtajan Meagan Phelanin mukaan työkalu ei ole vielä löytänyt tekoälyn luomia kuvia.

Springer Nature, Naturen kustantaja, kehittää omia tekstin ja kuvan tunnistustyökaluja, nimeltään Geppetto ja SnapShot, jotka ilmoittavat epäsäännöllisyyksistä, jotka ihmiset arvioivat. (Nature News -tiimi on toimituksellisesti riippumaton kustantajastaan.)

Julkaisuryhmät ovat myös ryhtyneet toimiin vastatakseen tekoälyn luomiin kuviin. Kansainvälisen tieteellisten, teknisten ja lääketieteellisten julkaisijoiden liiton (STM) tiedottaja Oxfordissa, Yhdistyneessä kuningaskunnassa, sanoi ottavansa asian "erittäin vakavasti" ja reagoivansa aloitteisiin, kuten United2Act ja STM Integrity Hub, joka käsittelee ajankohtaisia pakolliseen julkaisuun liittyviä kysymyksiä ja muita akateemisen eheyden kysymyksiä.

Christopher, joka johtaa STM-työryhmää kuvien muuttamisesta ja kopioimisesta, sanoo, että tietoisuus siitä, että on tarpeen kehittää tapoja tarkistaa raakadataa, on kasvamassa, esimerkiksi merkitsemällä mikroskoopeilla otettuihin kuviin näkymättömiä vesileimoja, jotka ovat samanlaisia kuin käytetyt. Vesileimat tekoälyn luomissa teksteissä – Se voisi olla oikea tapa. Tämä edellyttää uusia teknologioita ja uusia standardeja laitevalmistajilta, hän lisää.

Patrick ja muut ovat huolissaan siitä, että julkaisijat eivät toimi tarpeeksi nopeasti uhkaamiseksi. "Pelkäämme, että tämä on vain uusi sukupolvi kirjallisuuden ongelmia, joihin he eivät puutu ennen kuin on liian myöhäistä", hän sanoo.

Jotkut ovat kuitenkin optimistisia, että artikkeleissa nykyään esiintyvä tekoälyn luoma sisältö löydetään tulevaisuudessa.

"Uskon täysin, että tekniikka kehittyy siihen pisteeseen, että se tunnistaa nykyään luotavan tiedon – koska jossain vaiheessa sitä pidetään suhteellisen karkeana", Patrick sanoo. "Petterien ei pitäisi nukkua hyvin yöllä. He voivat huijata nykyisen prosessin, mutta en usko, että he voivat huijata prosessia ikuisesti."

-

Saguy, A. et ai. Pieni Meth. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto