Az AI által generált képek veszélyeztetik a tudományt – így akarják felismerni a kutatók

A kutatók a mesterséges intelligencia által generált hamis képek ellen küzdenek tudományos publikációkban. Új kimutatási módszerek alakulnak ki.

Az AI által generált képek veszélyeztetik a tudományt – így akarják felismerni a kutatók

Számokat manipuláló és hamis papírokat tömegesen előállító tudósok Kötelező kiadók – a problémás kéziratok régóta zavaróak a tudományos irodalomban. A tudományos nyomozók fáradhatatlanul dolgoznak, hogy feltárja ezt a jogsértést és kijavítsa a tudományos feljegyzéseket. Ám dolguk egyre nehezebbé válik, ahogy megjelent a csalók számára egy új, hatékony eszköz: a generatív mesterséges intelligencia (AI).

„A generatív AI nagyon gyorsan fejlődik” – mondja Jana Christopher, képintegritás-elemző a FEBS Pressnél, Heidelbergben, Németországban. „A körzetemben dolgozók – a kép integritása és a közzétételi irányelvek – egyre jobban aggódnak az általa kínált lehetőségek miatt.”

A könnyedség, amellyel generatív AI-eszközök szövegei, képek és adatok félelmet keltenek az egyre megbízhatatlanabb tudományos irodalomtól, amelyet hamis számok, kéziratok és következtetések árasztanak el, amelyeket az ember nehezen észlel. A fegyverkezési verseny már kialakulóban van, amiért az integritás specialisták, kiadók és technológiai cégek szorgalmasan dolgoznak AI-eszközök fejlesztése, amely segíthet gyorsan azonosítani a megtévesztő, mesterséges intelligencia által generált elemeket a szakcikkekben.

„Ijesztő fejlemény” – mondja Christopher. "De vannak okos emberek és jó strukturális változtatások is."

A kutatás integritásával foglalkozó szakértők arról számolnak be, hogy bár az AI által generált szöveget bizonyos körülmények között már számos folyóirat engedélyezi, az ilyen eszközök használata képek vagy egyéb adatok létrehozására kevésbé tekinthető elfogadhatónak. „A közeljövőben talán rendben leszünk a mesterséges intelligencia által generált szövegekkel” – mondja Erzsébet Bik, képtörvényszéki szakértő és tanácsadó a kaliforniai San Francisco-ban. "De én meghúzom a határt az adatok előállítása terén."

Bik, Christopher és mások azt sugallják, hogy a generatív mesterséges intelligencia segítségével létrehozott adatokat, beleértve a képeket is, már széles körben használják a szakirodalomban, és hogy a kötelező kiadók mesterséges intelligencia eszközöket használnak a kéziratok kötetben történő előállításához (lásd: „Kvíz: észlelhetsz mesterséges intelligencia-hamisításokat?”).

A mesterséges intelligencia által készített képek azonosítása óriási kihívást jelent: gyakran szinte lehetetlen szabad szemmel megkülönböztetni őket a valódi képektől. „Úgy érezzük, minden nap találkozunk mesterséges intelligencia által generált képekkel” – mondja Christopher. – De hacsak nem tudod bizonyítani, nagyon keveset tehetsz.

Van néhány egyértelmű példa a generatív mesterséges intelligencia tudományos képekben való használatára, mint pl most hírhedt kép egy abszurd nagy nemi szervvel rendelkező patkányról és értelmetlen címkék, amelyeket a Midjourney képeszközzel hoztak létre. Az egy szakmai magazin által februárban megjelent grafika vihart kavart a közösségi médiában, és az is volt néhány nappal később visszavonták.

A legtöbb eset azonban nem ilyen egyértelmű. Az Adobe Photoshop vagy hasonló eszközökkel a generatív mesterséges intelligencia megjelenése előtt készített figurák – különösen a molekuláris és sejtbiológiában – gyakran tartalmaznak olyan feltűnő jellemzőket, amelyeket a detektívek felismerhetnek, mint például az azonos hátteret vagy a csíkok vagy foltok szokatlan hiányát. Az AI által generált karakterek gyakran nem mutatnak ilyen tulajdonságokat. „Rengeteg papírt látok, ami miatt azt gondolom, hogy ezek a Western blotok nem tűnnek valódinak – de nincs füstölő pisztoly” – mondja Bik. – Csak annyit lehet mondani, hogy furcsán néznek ki, és ez persze nem elég bizonyíték a szerkesztővel való kapcsolatfelvételhez.

A jelek szerint azonban mesterséges intelligencia által generált karakterek jelennek meg a publikált kéziratokban. A ChatGPT-hez hasonló eszközökkel írt szövegek száma egyre szaporodik a cikkekben, ami jól látszik a tipikus chatbot-kifejezésekből, amelyeket a szerzők elfelejtenek eltávolítani, valamint a megkülönböztető szavakból, amelyeket az AI-modellek szoktak használni. „Tehát azt kell feltételeznünk, hogy ez az adatok és képek esetében is megtörténik” – mondja Bik.

Egy másik jele annak, hogy a csalók kifinomult képalkotó eszközöket használnak, az, hogy a nyomozók által jelenleg tapasztalt problémák többsége több éves művekben jelenik meg. „Az elmúlt években egyre kevesebb problémát tapasztaltunk a képekkel” – mondja Bik. "Azt hiszem, a legtöbb ember, akit rajtakaptak a képek manipulálásán, tisztább képeket kezdett alkotni."

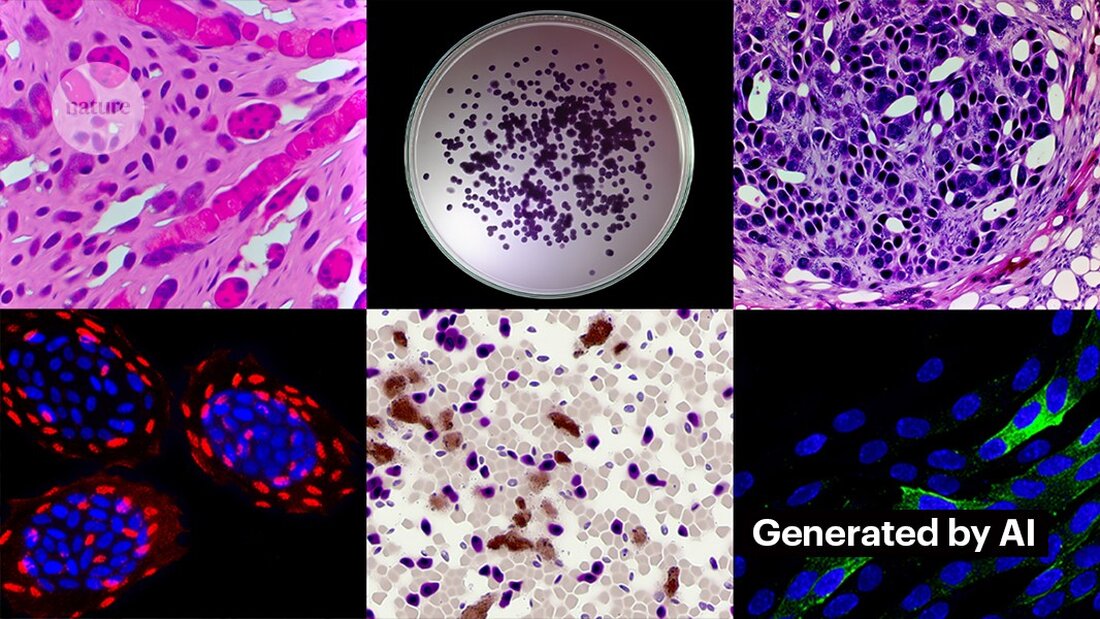

A tiszta képeket generatív mesterséges intelligencia segítségével nem nehéz létrehozni. Kevin Patrick, a közösségi médiában Cheshire néven ismert tudományos képnyomozó bemutatta, hogy ez milyen egyszerű is lehet, és eredményeit az X-en tette közzé. A Photoshop AI Generative Fill eszközével Patrick valósághű képeket készített – amelyek tudományos közleményekben is megjelenhetnek – daganatokról, sejtkultúrákról, Western blotokról és egyebekről. A legtöbb kép elkészítése kevesebb mint egy percet vett igénybe (lásd: „Hamis tudomány generálása”).

„Ha ezt megtehetem, akkor biztosan azok is megteszik, akiket hamis adatok létrehozásáért fizetnek” – mondja Patrick. "Valószínűleg sok más adat is előállítható az ehhez hasonló eszközökkel."

Egyes kiadók arról számolnak be, hogy a publikált tanulmányokban bizonyítékot találtak mesterséges intelligencia által generált tartalomra. Ide tartozik a PLoS, amelyet gyanús tartalomra figyelmeztettek, és belső vizsgálatok során mesterséges intelligencia által generált szövegekre és adatokra talált cikkekben és beadványokban – mondta Renée Hoch, a PLoS publikációs etikai csoportjának szerkesztője a kaliforniai San Franciscóban. (Hoch megjegyzi, hogy a mesterséges intelligencia használata nem tilos a PLoS folyóiratokban, és az AI szabályzat a szerző felelősségén és az átlátható közzétételen alapul.)

Más eszközök is lehetőséget nyújthatnak azoknak, akik hamis tartalmat szeretnének létrehozni. A múlt hónapban a kutatók közzétették a 1 generatív AI-modell nagy felbontású mikroszkópképek készítéséhez – és néhány integritás-szakértő aggodalmát fejezte ki ezzel a munkával kapcsolatban. „Ezt a technológiát a rossz szándékú emberek könnyen használhatják több száz vagy több ezer hamis kép létrehozására” – mondja Bik.

Yoav Shechtman, a haifai Technion–Israel Institute of Technology munkatársa, az eszköz megalkotója szerint az eszköz hasznos a modellek képzési adatainak létrehozásához, mivel nehéz nagy felbontású mikroszkóp képeket szerezni. De hozzáteszi, hogy ez nem hasznos hamisítványok generálásához, mert a felhasználóknak alig van befolyása az eredményekre. A meglévő képszerkesztő szoftverek, például a Photoshop hasznosabbak a figurák manipulálásához, javasolja.

Bár az emberi szem nem biztos, hogy képes rá Az AI által generált képek felismerése, az AI esetleg megteheti ezt (lásd: „Az AI-képeket nehéz felismerni”).

Az olyan eszközök fejlesztői, mint az Imagetwin és a Proofig, amelyek mesterséges intelligencia segítségével észlelik a tudományos képek integritási problémáit, bővítik szoftvereiket a generatív mesterséges intelligencia által létrehozott képek szűrésére. Mivel az ilyen képeket nagyon nehéz felismerni, mindkét vállalat létrehozza saját generatív mesterséges intelligencia-képek adatbázisát, hogy megtanítsa algoritmusait.

A Proofig már kiadott egy funkciót az AI által generált mikroszkópképek felismerésére szolgáló eszközében. Az izraeli Rehovotban élő Dror Kolodkin-Gal társalapítója azt mondja, hogy a cikkekből származó több ezer mesterséges intelligencia által generált és valós képpel végzett tesztelés során az algoritmus az esetek 98%-ában helyesen azonosította a mesterséges intelligencia képeket, és 0,02%-os hamis pozitív arányt mutatott. Dror hozzáteszi, hogy a csapat most azt próbálja megérteni, hogy pontosan mit is észlel az algoritmusuk.

„Nagy reményeket fűzök ezekhez az eszközökhöz” – mondja Christopher. Megjegyzi azonban, hogy eredményeiket mindig olyan szakértőknek kell értékelniük, akik ellenőrizni tudják az általuk jelzett problémákat. Christopher még nem látott bizonyítékot arra, hogy az AI képfelismerő szoftver megbízható lenne (a Proofig belső értékelését még nem tették közzé). Ezek az eszközök „korlátozottak, de minden bizonnyal nagyon hasznosak abban, hogy növeljük a benyújtás ellenőrzésére irányuló erőfeszítéseinket” – teszi hozzá.

Sok kiadó és kutatóintézet használja már Bizonyíték és Imagetwin. A Science folyóiratok például a Proofig segítségével ellenőrzik a képek integritását. Meagan Phelan, a Washington DC-ben működő Science kommunikációs igazgatója szerint az eszköz még nem fedezett fel mesterséges intelligencia által generált képeket.

A Springer Nature, a Nature kiadója saját szöveg- és képfelismerő eszközeit fejleszti, Geppetto és SnapShot néven, amelyek jelzik a szabálytalanságokat, amelyeket aztán az emberek értékelnek. (A Nature news csapata szerkesztőileg független a kiadójától.)

A kiadói csoportok is lépéseket tesznek a mesterséges intelligencia által generált képekre való reagálás érdekében. A Tudományos, Műszaki és Orvosi Kiadók Nemzetközi Szövetségének (STM) szóvivője Oxfordban (Egyesült Királyság) azt mondta, hogy "nagyon komolyan" veszi a kérdést, és reagál az olyan kezdeményezésekre, mint pl. United2Act és az STM Integrity Hub, amely a kötelező közzététellel kapcsolatos aktuális problémákkal és más tudományos integritási kérdésekkel foglalkozik.

Christopher, aki a képmódosításokkal és sokszorosításokkal foglalkozó STM-munkacsoportot vezeti, egyre jobban tudatában van annak, hogy ki kell majd fejleszteni a nyers adatok ellenőrzésének módjait – például a mikroszkóppal készült képeket a használtakhoz hasonló, láthatatlan vízjelekkel címkézve. Vízjelek mesterséges intelligencia által generált szövegekben – ez lehet a helyes út. Ehhez új technológiákra és új szabványokra van szükség az eszközgyártók számára – teszi hozzá.

Patrick és mások attól tartanak, hogy a kiadók nem cselekszenek elég gyorsan a fenyegetés kezelésére. „Attól tartunk, hogy ez csak egy újabb generációs probléma lesz az irodalomban, amelyekkel nem foglalkoznak, amíg nem késő” – mondja.

Ennek ellenére egyesek bizakodóak abban, hogy a ma cikkekben megjelenő mesterséges intelligencia által generált tartalmat a jövőben felfedezik majd.

„Biztos vagyok abban, hogy a technológia addig a pontig fog fejlődni, hogy felismerje a jelenleg keletkező adatokat – mert egy ponton ezt viszonylag durvának fogják tekinteni” – mondja Patrick. "A csalóknak nem szabad jól aludniuk éjszakánként. Megbolondíthatják a jelenlegi folyamatot, de nem hiszem, hogy örökre megtéveszthetik a folyamatot."

-

Saguy, A. et al. Small Meth. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto